Samsung скоротить виробництво оперативної пам'яті DDR4

Виробники пам'яті DRAM та NAND в останні квартали зіткнулися із суттєвим падінням доходів. Згідно з прогнозами аналітиків, найближчим часом мікросхеми продовжать дешевшати, що підштовхує лідерів галузі до скорочення виробництва чипів. Про такі наміри на початку року оголосили компанії SK Hynix та Micron.

Фінансові результати Samsung Electronics за перший квартал 2023 виявилися найгіршими за останні 14 років. Виторг південнокорейського гіганта скоротилася на 18% щодо аналогічного періоду минулого року, тоді як прибуток упав одразу на 95%. При цьому чипмейкеру належить близько 45,1% та 33,8% світових ринків пам'яті DRAM та NAND відповідно.

Щоб виправити ситуацію, Samsung теж вирішила скоротити обсяги випуску мікросхем. Це рішення торкнеться пам'яті як NAND, так і DRAM, причому найбільше постраждає виробництво чипів DDR4. За попередніми оцінками, обмеження триватимуть від трьох до шести місяців, а за підсумками 2023 року корейці випустять на 25% менше мікросхем DRAM. Додамо, що цього кварталу оперативна пам'ять має подешевшати на 15-20%.

Джерело:

TechSpot

Nvidia збільшує замовлення на процесори для прискорювачів обчислень

На тлі зростання інтересу до генеративних нейромереж Nvidia вирішила збільшити обсяги випуску прискорювачів обчислень. Контрактний чипмейкер TSMC отримав від «зелених» замовлення на виробництво додаткових 10 тисяч кремнієвих пластин з технологією компонування чипів CoWoS (Chip-on-Wafer-on-Substrate) протягом 2023 року. Про це повідомило тайванське веб-видання DigiTimes із посиланням на джерела в галузі.

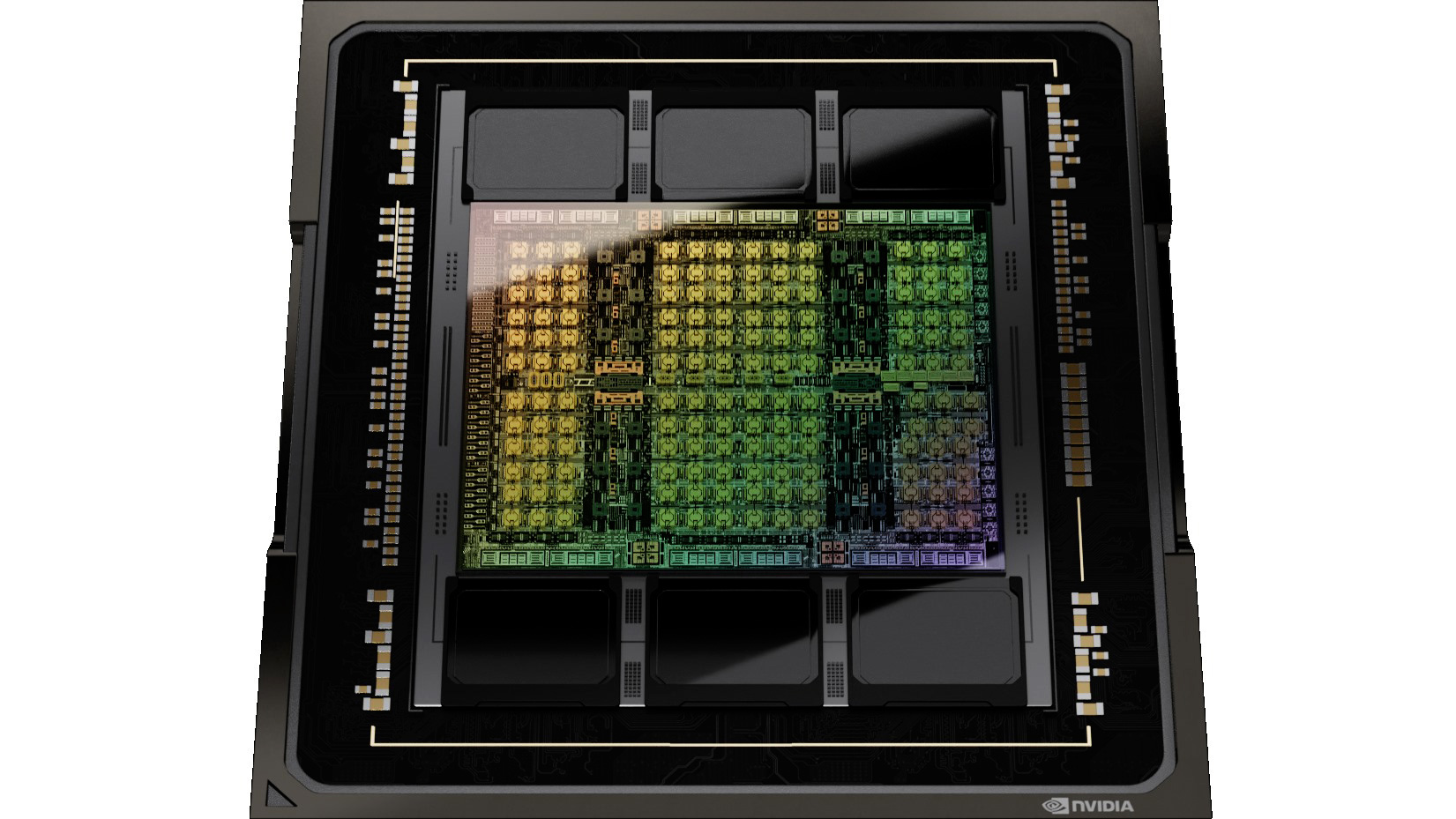

Процесор Nvidia GH100

Збільшення замовлення означає, що TSMC щомісяця вироблятиме для Nvidia додаткові одну-дві тисячі пластин CoWoS до кінця року. Тут варто додати, що їхні місячні обсяги випуску оцінюються на рівні 8-9 тисяч пластин. Внаслідок цього доступність відповідного конвеєра TSMC для інших компаній може виявитися обмеженою, зазначає джерело.

Технологія CoWoS використовується при випуску найпродуктивніших GPU Nvidia, на кшталт 4-нм процесора H100 з архітектурою Hopper, який є серцем однойменного прискорювача обчислень. До речі, нещодавно компанія представила окрему модифікацію H100 NVL для запуску великих мовних моделей, таких як сімейство GPT від компанії OpenAI.

Останні огляди:

- Огляд та тестування процесорів AMD Ryzen 7 7800X3D та Ryzen 9 7950X3D. 3D Vertical Cache для геймінгу та роботи

- Огляд та тестування 15,6″ портативного монітору ASUS ZenScreen MB16AHG

- Від відеокарт до штучного інтелекту: історія компанії NVIDIA

- Огляд бездротової гарнітури Aula Mountain S6

- Огляд та тестування материнської плати MSI MPG Z790 EDGE TI MAX WIFI для платформи Intel LGA1700

- Огляд та тестування ігрового 27″ OLED-монітору Acer Predator X27U з частотою оновлення 240 Гц

- Огляд та тестування ігрового 27″ WQHD-монітора MSI MPG 271QRX QD-OLED з частотою оновлення 360 Гц